【導讀】在過去的2~3年間,端到端技術(shù)大規(guī)模鋪開,為輔助駕駛體驗帶來了顯著進展。與此同時,基于推理能力的人工智能出現(xiàn),使行業(yè)真正迎來了一個類似ChatGPT的里程碑時刻。從當前技術(shù)發(fā)展來看,通往L4級完全自動駕駛甚至無人駕駛的道路已經(jīng)相對清晰。在這一大背景下,英偉達(NVIDIA)一直在努力推動整個行業(yè)盡早實現(xiàn)L4級自動駕駛,比如今年推出了面向輔助駕駛汽車的開放模型Alpamayo,成為今年L4發(fā)展的一個重要里程碑。

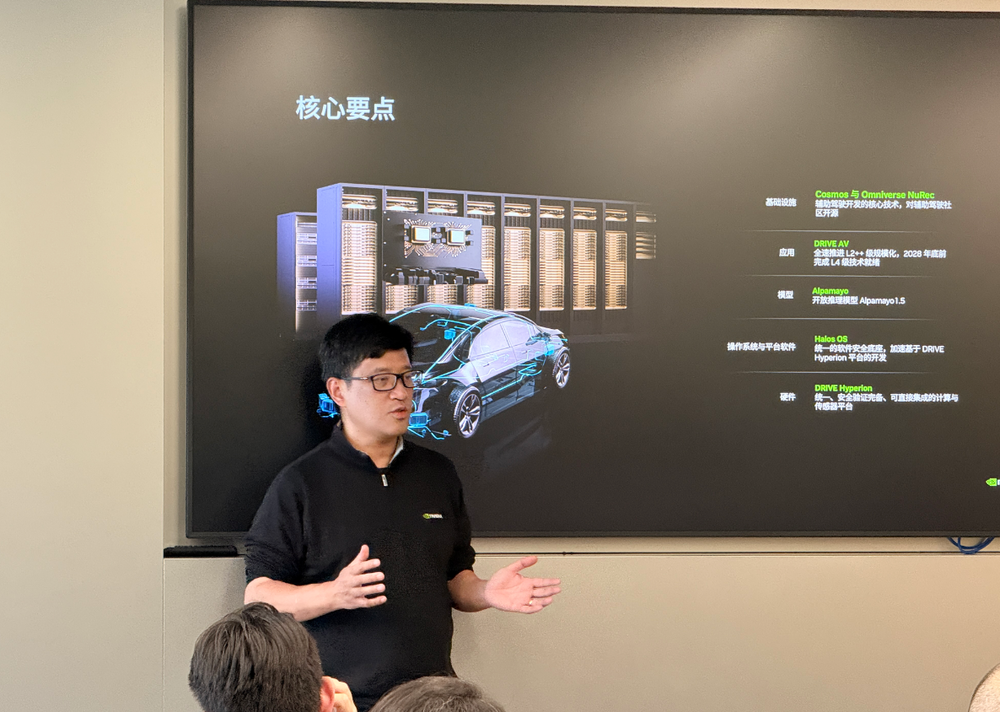

不過,通向L4的道路一定需要一個完整的平臺化的解決方案,英偉達其實一直在朝向這個方向努力。對于L4級自動駕駛,英偉達當下的打法究竟是怎么樣的?2026年,北京車展期間,英偉達全球副總裁吳新宙向包括EEWorld在內(nèi)的媒體進行了深度分享。

自動駕駛是物理AI最早量產(chǎn)場景

“提供全棧解決方案只是工作的一部分,對英偉達而言更重要的使命是賦能整個產(chǎn)業(yè),推動其盡快向L3或L4級無人駕駛能力發(fā)展。“吳新宙如是說。

他介紹,英偉達一直是人工智能領(lǐng)域 重要的推動者。自動駕駛作為人工智能最大的受益者之一,其發(fā)展歷程與AI技術(shù)演進密不可分。2012年AlexNet出現(xiàn)后,感知AI能力使許多傳統(tǒng)計算機視覺難以解決的問題得以通過數(shù)據(jù)驅(qū)動的方法解決。2017年Transformer架構(gòu)打開了新的大門,首次實現(xiàn)360度感知的穩(wěn)定與優(yōu)秀表現(xiàn),使基于BEV的感知得以落地,全模型方法開始應(yīng)用于規(guī)控領(lǐng)域。近兩年出現(xiàn)的代理式AI,特別是大語言模型帶來的推理能力,成為高效且規(guī)模化解決所有邊緣場景問題的關(guān)鍵鑰匙。

從感知AI到代理式AI,最終落地到物理世界,就是物理AI。英偉達創(chuàng)始人兼首席執(zhí)行官黃仁勛多次強調(diào),未來十年是公司乃至整個產(chǎn)業(yè)和科技行業(yè)最核心的挑戰(zhàn)。

吳新宙強調(diào),“英偉達堅信,自動駕駛將是物理AI領(lǐng)域最早實現(xiàn)量產(chǎn)和大規(guī)模落地的場景。”

從經(jīng)濟價值看,全球每年車輛行駛里程約為13萬億英里,其中自動駕駛歷程僅為7億英里,占比僅為0.006%左右,幾乎可以忽略不計。英偉達相信 每一英里最終都將變?yōu)樽詣玉{駛。若每英里自動駕駛解決方案價值1~2美元,這將是一個體量巨大的市場。更重要的是,技術(shù)已經(jīng)發(fā)展到能夠?qū)崿F(xiàn)L4的時間節(jié)點,這是令人激動的時刻。

五層“蛋糕”服務(wù)架構(gòu)

解決物理AI問題需要三臺關(guān)鍵計算機:第一臺是車端計算機,英偉達已在這方面投入十年時間,做了大量工作;第二臺是云端訓練計算機,所有模型都在英偉達的CUDA生態(tài)中成長,該生態(tài)是所有模型的根基;第三臺是仿真計算機,在端到端模型時代,仿真變得尤為重要。

英偉達在這三臺計算機上都投入了強大的產(chǎn)品,助力物理AI的發(fā)展。基于三大計算平臺,英偉達構(gòu)建了五層“蛋糕”的技術(shù)服務(wù)架構(gòu),吳新宙逐層進行了介紹:

第一層,基礎(chǔ)設(shè)施:NVIDIA Cosmos and Omniverse NuRec

涵蓋云端訓練、數(shù)據(jù)處理、標注、仿真驗證等全流程工具。英偉達憑借數(shù)十年圖形技術(shù)積累,具備物理世界像素級重建、照片級虛擬場景生成能力,可高效支撐輔助 駕駛模型訓練與驗證,日均完成 200萬次場景仿真驗證,通過場景編輯、環(huán)境倍增等技術(shù),將數(shù)據(jù)驗證效率提升5~10倍。

第二層,應(yīng)用:NVIDIA DRIVE AV

為缺乏自主研發(fā)能力的車企提供一站式 “交鑰匙” 解決方案,目前已與奔馳、Lucid等多家車企達成深度合作,助力其車型快速具備高階輔助 駕駛能力。

第三層,開放模型:NVIDIA Alpamayo

Alpamayo是秘魯一座著名的山峰,被稱為最美麗但也最難攀登的山。這個名字恰如其分地形容了解決端到端輔助 駕駛問題的難度。英偉達所做的是通過硬件、操作系統(tǒng)和開放模型,盡可能降低這一門檻。

車廠或軟件提供商可以從Alpamayo開始進行微調(diào),產(chǎn)生產(chǎn)品級方案,在英偉達硬件平臺和操作系統(tǒng)上順暢運行。Alpamayo模型在Hugging Face上獲得了第二名的下載量,在LingoQA榜單上的輔助駕駛推理模型排名第一。

今年GTC期間,英偉達發(fā)布的Alpamayo的1.5版本,新增了導航能力,并增加了靈活的多攝像頭支持和可配置的攝像頭參數(shù),簡化了同一套 AI 駕駛棧在不同車型、不同傳感器配置中的復用,同時保留與現(xiàn)有Alpamayo集成的兼容性。吳新宙預告,今年6月將發(fā)布2.0版本,模型能力持續(xù)迭代。

訓練Alpamayo模型使用了8萬小時駕駛數(shù)據(jù),但因其主干基于Cosmos系列蒸餾而來,而Cosmos是基于互聯(lián)網(wǎng)和YouTube等全球視頻數(shù)據(jù)訓練的基礎(chǔ)模型,因此繼承了對物理世界的深刻理解,再針對駕駛數(shù)據(jù)進行最后的微調(diào)。

第四層,操作系統(tǒng)和平臺軟件:NVIDIA Halos OS

Halos OS是對原有Drive OS的擴充。Drive OS是運行在芯片中的操作系統(tǒng)軟件,英偉達以最高安全等級要求進行開發(fā),使車廠或軟件開發(fā)者可以在安全無后顧之憂的情況下,在英偉達平臺上開發(fā)車用軟件。

對Halos OS的擴充包括加入Halos SDK,使車廠能夠更容易地開發(fā)軟件。其中包含車輛擴展層和傳感器擴展層,將這兩層標準化后,車廠適配不同硬件、傳感器或車輛的工作量將大幅減少。

此外,Halos OS還將主動安全系統(tǒng)和一些基于規(guī)則的經(jīng)典算法納入其中。模型供應(yīng)商或軟件開發(fā)者可以在最高安全等級的硬件和底層操作系統(tǒng)上,利用規(guī)則兜底方案,更容易地通過各種安全認證,包括中國的CNCAP、美國的FMVSS、NCAP等。

第五層,硬件:NVIDIA Drive Hyperion

涵蓋車載計算芯片與傳感器,英偉達和業(yè)界一同定義了支持 L4 級無人駕駛的標準化硬件平臺,實現(xiàn)數(shù)據(jù)互通共享。

Drive Hyperion平臺基于Thor芯片架構(gòu)打造,該架構(gòu)也是云端大模型訓練的核心算力支撐。針對車載端存儲帶寬限制,芯片支持FP4精度,有效提升算力利用率,總算力較前代產(chǎn)品大幅提升。

傳感器配置分為基礎(chǔ)版與高階版:基礎(chǔ)版以純視覺+毫米波雷達為主,配備10個高清外置攝像頭、3個毫米波雷達、12個超聲波傳感器、1個DRIVE AGX Thor,可支撐優(yōu)質(zhì)L2+級體驗;高階版面向L3、L4 級,配備14個高清外置攝像頭、9個毫米波雷達、12個超聲波雷達、1個激光雷達,2個DRIVE AGX Thor架構(gòu)ECU,實現(xiàn)控制器與傳感器全冗余,確保單點失效下系統(tǒng)仍可完成最小風險操作,保障行駛安全。依托該標準化配置,英偉達正與合作伙伴采集百萬小時級駕駛數(shù)據(jù)并向生態(tài)開放,大幅降低行業(yè)數(shù)據(jù)門檻。

英偉達輔助駕駛的核心戰(zhàn)略

吳新宙強調(diào),英偉達想要推動行業(yè)采用Drive Hyperion標準化平臺,該平臺硬件與傳感器均經(jīng)過充分驗證,可實現(xiàn)數(shù)據(jù)互通共享;同時推廣Halos OS高安全等級操作系統(tǒng),降低開發(fā)者門檻;持續(xù)開放 Alpamayo模型、配套數(shù)據(jù)與工具,削減行業(yè)研發(fā)成本;最終為有需求的車企提供全棧解決方案。

英偉達在輔助駕駛領(lǐng)域已深耕十年,從早期芯片供應(yīng),逐步拓展至云端訓練中心、全棧車載解決方案。2017年英偉達率先提出端到端輔助駕駛解決方案,2020年與奔馳達成合作,2025 年完成歐美地區(qū)方案交付,后續(xù)還將與更多車企展開合作。

當前英偉達的算法棧采用混合端到端架構(gòu),以模仿學習為核心,實現(xiàn)類人駕駛體驗,同時并行運行經(jīng)典規(guī)則算法棧,形成安全護欄。2025年,該方案在歐洲E-NCAP測評中斬獲年度第一。量產(chǎn)方案迭代頻次極高,日均完成海量仿真驗證。通過經(jīng)典算法兜底,可有效提升駕乘安全性與舒適度,應(yīng)對各類復雜路況。

目前,英偉達正推進L2++全球化規(guī)模化落地,已完成舊金山、洛杉磯、紐約、倫敦、慕尼黑等城市路測,目標在2026年實現(xiàn)全球化量產(chǎn)。與此同時,方案正加速向L3、L4級遷移,通過雙算法棧冗余、硬件冗余與激光雷達加持,滿足高階自動駕駛的安全要求。

從時間規(guī)劃來看:2025年官宣與奔馳合作進展;2026年實現(xiàn)L2++點對點功能在美國落地,并拓展至歐洲等地區(qū);2027年計劃與合作伙伴在部分城市開展L4試點;2028年為洛杉磯奧運會提供L4級無人駕駛服務(wù),計劃覆蓋20~30個城市。

除輔助駕駛外,英偉達還依托 AI 技術(shù)深度賦能車企整車設(shè)計、生產(chǎn)制造、產(chǎn)線規(guī)劃等環(huán)節(jié),助力車企全流程智能化升級,提升運營效率。

英偉達對于當下輔助駕駛的判斷

談及當下爭議不休的激光雷達,吳新宙給出了判斷:對于L2+級輔助駕駛,純視覺路線不僅可行,其感知上限“極高”,視覺模型所依賴的像素密度遠超激光雷達。然而,當系統(tǒng)邁向L3與L4級時,激光雷達的角色便從可選變?yōu)楸匾!八菍崿F(xiàn)傳感器冗余、保障安全的關(guān)鍵部件。” 目前,英偉達正聯(lián)合歐美產(chǎn)業(yè)鏈伙伴,持續(xù)推進激光雷達供應(yīng)的穩(wěn)定性,為L3、L4級技術(shù)的規(guī)模化落地筑牢基礎(chǔ)。

有人說,L3這一階段會被跳過,行業(yè)會直接步入L4階段。對此,吳新宙表示,從技術(shù)層面來看,當前輔助 駕駛已經(jīng)沒有核心卡點。隨著生成式AI和推理AI的發(fā)展,以往難以解決的極端場景、決策邏輯等問題,都已經(jīng)有了可行的解決方案。現(xiàn)在的主要挑戰(zhàn)在于系統(tǒng)工程的整合和規(guī)模化落地的工程量。

他指出,輔助駕駛不是單一技術(shù)的突破,而是硬件、軟件、數(shù)據(jù)、仿真等多環(huán)節(jié)的協(xié)同,需要大量的工程迭代和驗證。至于L3與L4級,兩者在技術(shù)難度上差距并不大,更多是應(yīng)用場景和責任界定的差異:L3要求駕駛員在10秒內(nèi)接管車輛,這10秒內(nèi)車輛需承擔完全責任,它在高速場景下能有效解放駕駛員雙手,具備明確的用戶價值;而L4級則更多依賴云端遠程運營支撐,對于年銷百萬輛的車企而言,為每輛車配備這種能力成本極高。

因此,短期內(nèi)L3與L4級將并行發(fā)展,一個服務(wù)于個人出行的效率提升,一個運行于運營場景的商業(yè)閉環(huán)。

艙駕融合是當下行業(yè)一大趨勢,吳新宙表示,車輛本質(zhì)上其實也是一種移動機器人,座艙交互與輔助駕駛對安全等級要求不同,短期內(nèi)可能不會共用同一顆芯片。但大模型的能力將逐步共享,最終走向感知、決策與交互的一體化。在輔助駕駛芯片上同時提供人機交互能力,這是非常值得期待的方向。

同樣值得期待的,還有輔助駕駛與機器人賽道的重合關(guān)系。吳新宙將兩者都歸入物理AI的核心范疇,但它指出輔助駕駛已率先接近規(guī)模化落地的臨界點。英偉達同樣看好機器人,但眼下,輔助駕駛是物理AI浪潮中最先涌起的那個浪頭。

面對部分車企掀起的自研芯片浪潮,吳新宙也真誠地保持歡迎和開放的心態(tài)。“英偉達并不排斥車企自研芯片,”他說,“我們始終以推動整個生態(tài)發(fā)展為核心。”即便一家車企完全放棄了英偉達的車載推理芯片,它可能仍然離不開英偉達的云端訓練、仿真算力與開源技術(shù)。在吳新宙看來,AI產(chǎn)業(yè)整體的發(fā)展,最終一定會反哺英偉達的算力需求,這是一場沒有輸家的共生游戲。